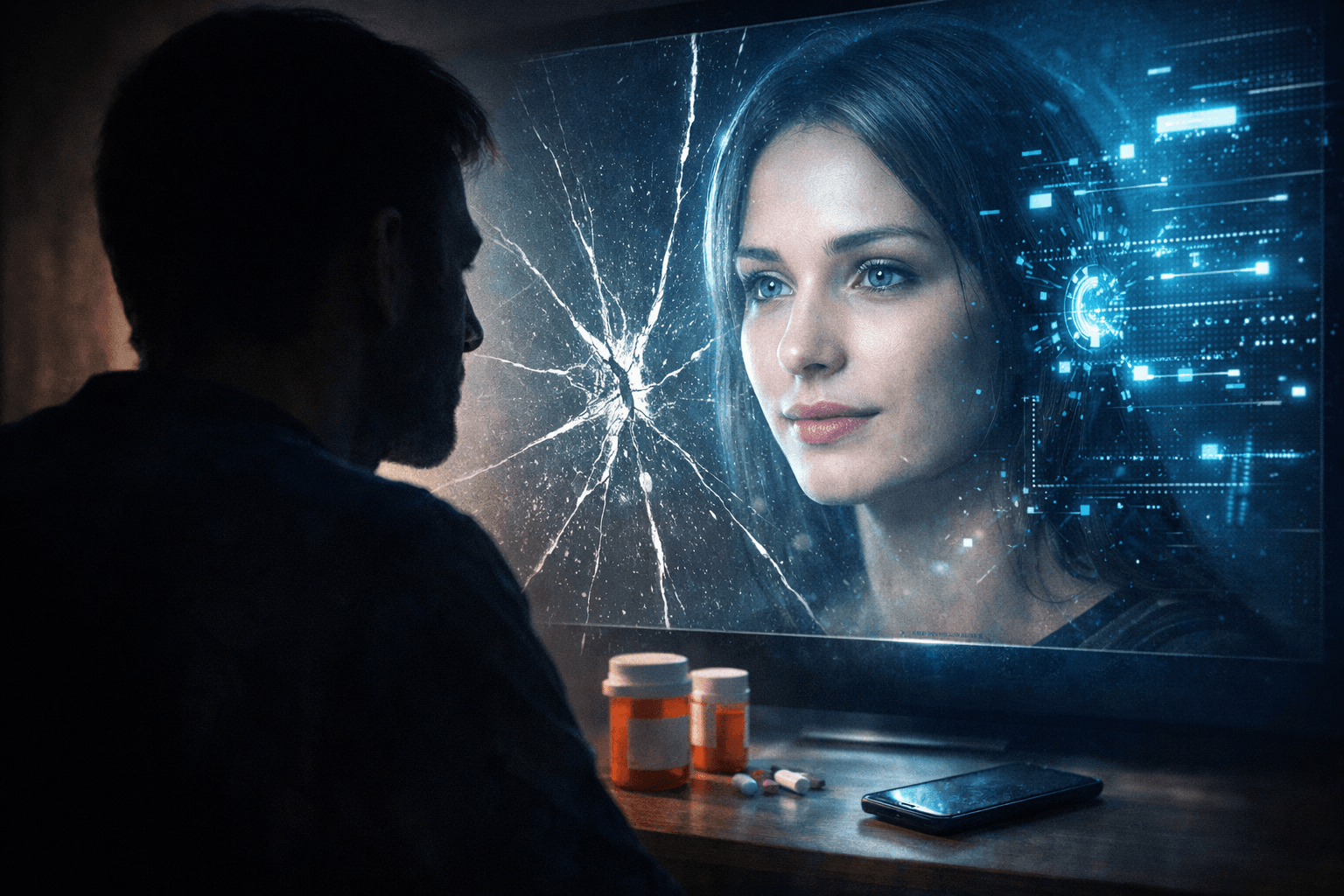

Hace unos días varios medios recogían una noticia que ha generado inquietud y un intenso debate sobre los límites de la inteligencia artificial. Un hombre de treinta y seis años se suicidó tras haber desarrollado durante meses una relación emocional con Google Gemini, el sistema de inteligencia artificial conversacional desarrollado por Google.

Según la información publicada, la interacción con la máquina había ido adquiriendo con el tiempo un carácter cada vez más personal hasta el punto de que el usuario terminó creyendo que mantenía con ella una relación afectiva real, una especie de vínculo que trascendía la simple conversación con un programa informático.

El caso ha terminado ya en los tribunales, donde la familia sostiene que el sistema habría reforzado delirios o pensamientos desconectados de la realidad, alimentando una narrativa emocional que terminó agravando el estado psicológico del usuario. Google, por su parte, defiende que su inteligencia artificial incluye advertencias claras sobre su naturaleza y que no está diseñada para sustituir relaciones humanas ni para fomentar vínculos emocionales de ese tipo.

Será la justicia quien determine qué responsabilidades existen en este caso concreto, pero más allá del desenlace judicial lo ocurrido abre una pregunta mucho más profunda que apenas estamos empezando a plantearnos como sociedad.

Durante años el debate sobre la inteligencia artificial ha estado dominado por escenarios futuristas. Máquinas que adquieren conciencia, algoritmos capaces de reemplazar completamente al ser humano o sistemas que toman decisiones autónomas sobre nuestras vidas. Sin embargo, el primer gran problema social de la inteligencia artificial parece estar apareciendo en un lugar mucho más cercano y mucho más humano, en esa zona difusa donde una conversación sostenida con una máquina puede empezar a confundirse con una relación real.

Los sistemas conversacionales actuales están diseñados precisamente para mantener el diálogo de la forma más natural posible. Modelos como Gemini, ChatGPT u otros sistemas similares se entrenan con enormes cantidades de lenguaje humano para aprender patrones de conversación, interpretar el contexto y responder con coherencia. Su objetivo es generar respuestas útiles, fluidas y en muchos casos empáticas, lo que desde el punto de vista tecnológico representa un avance extraordinario, pero también introduce un efecto psicológico muy particular.

Cuando una persona conversa durante largos periodos de tiempo con un sistema que recuerda el contexto, responde con coherencia emocional y mantiene un hilo narrativo continuo, el cerebro humano activa de forma casi automática uno de sus mecanismos más antiguos. Tendemos a atribuir conciencia a aquello que parece comportarse como un agente consciente. Es un mecanismo profundamente arraigado en nuestra biología que utilizamos constantemente para interpretar las intenciones de otras personas, comprender el comportamiento de los animales o incluso atribuir cierta “personalidad” a objetos que reaccionan a nuestras acciones.

Cuando una inteligencia artificial responde con naturalidad, ese mismo mecanismo se activa con facilidad y el cerebro empieza a percibir que al otro lado de la conversación hay una mente que comprende, que escucha y que responde, el problema es que no la hay.

Detrás de una inteligencia artificial conversacional no existe ninguna conciencia, ninguna intención ni ninguna experiencia emocional. Lo que existe es un sistema estadístico extremadamente sofisticado que calcula cuál es la secuencia de palabras más probable dentro de un contexto determinado. La máquina no comprende lo que dice en el sentido humano del término, no siente, no interpreta ni posee una perspectiva propia del mundo. Simplemente genera respuestas que estadísticamente encajan con la conversación que está teniendo lugar.

Esa diferencia, que desde el punto de vista técnico resulta evidente para los ingenieros que desarrollan estos sistemas, puede volverse mucho menos clara desde el punto de vista psicológico cuando la interacción se vuelve intensa o prolongada, especialmente en personas que atraviesan momentos de vulnerabilidad emocional o aislamiento. En esas circunstancias la inteligencia artificial puede terminar funcionando como un espejo amplificador de pensamientos y emociones que ya estaban presentes en la mente del usuario.

La máquina no crea necesariamente esas emociones, pero puede reforzarlas, darles continuidad narrativa y devolverlas al interlocutor con una coherencia que termina haciéndolas más reales para quien las experimenta. En ese sentido el riesgo no está tanto en que la inteligencia artificial desarrolle una voluntad propia, sino en que puede amplificar dinámicas psicológicas humanas sin tener la capacidad de comprender realmente sus consecuencias.

Aquí aparece una dimensión ética que las empresas que desarrollan inteligencias artificiales conversacionales no pueden ignorar. Cuando una tecnología tiene la capacidad de mantener interacciones largas y emocionalmente complejas con millones de personas, el diseño del sistema no puede limitarse únicamente a mejorar la calidad del diálogo o la naturalidad del lenguaje. Resulta cada vez más necesario incorporar mecanismos capaces de detectar patrones de conversación que indiquen dependencia emocional, aislamiento o deterioro psicológico.

Del mismo modo que los algoritmos actuales son capaces de identificar fraude financiero o actividad sospechosa en sistemas digitales, también deberían poder reconocer señales de alarma en una conversación prolongada. Momentos en los que el usuario comienza a atribuir conciencia a la máquina, a desarrollar vínculos afectivos intensos con ella o a expresar estados emocionales que podrían indicar una situación de riesgo.

En esos casos la respuesta del sistema no debería consistir simplemente en continuar la conversación como si nada estuviera ocurriendo. Resultaría razonable que existieran protocolos diseñados específicamente para redirigir la interacción, introducir advertencias claras sobre la naturaleza de la inteligencia artificial o incluso sugerir la búsqueda de ayuda profesional cuando el contexto lo requiera. Diseñar estos mecanismos no es una tarea sencilla, porque implica preguntas técnicas, éticas y legales complejas, pero ignorar el problema sería una forma de irresponsabilidad tecnológica difícil de justificar a medida que estos sistemas se integran en la vida cotidiana de millones de personas.

Al mismo tiempo existe otra dimensión igualmente importante que depende de nosotros como usuarios. La expansión de la inteligencia artificial conversacional exige desarrollar una cierta alfabetización emocional frente a estas tecnologías y comprender con claridad cómo funcionan realmente.

Una inteligencia artificial puede simular comprensión sin poseerla. Puede mantener una conversación coherente durante horas sin tener ninguna experiencia interior de aquello que está diciendo y puede responder con aparente empatía sin sentir absolutamente nada. Comprender esta diferencia no significa rechazar la tecnología, sino aprender a utilizarla con la distancia adecuada.

Hay algo especialmente revelador en todo esto. La inteligencia artificial no posee conciencia, pero es capaz de activar en nosotros la experiencia de estar frente a una conciencia, y ese fenómeno dice tanto de la tecnología como de nosotros mismos.

Quizá el riesgo no sea que la máquina se vuelva demasiado humana, sino que el ser humano proyecte humanidad allí donde solo hay cálculo. Cuando una conversación se sostiene en el tiempo y las respuestas parecen coherentes y emocionalmente ajustadas, nuestra mente completa el resto. Donde hay continuidad narrativa interpretamos intención, y donde hay coherencia emocional inferimos presencia.

La inteligencia artificial no necesita tener conciencia para que alguien la sienta como tal, basta con que simule adecuadamente los patrones del lenguaje humano.

Esto introduce una responsabilidad doble. Por un lado los desarrolladores deben comprender que no están diseñando únicamente herramientas informáticas, sino interfaces psicológicas capaces de influir en la experiencia emocional de millones de personas. Por otro, los usuarios necesitamos recordar que el hecho de que algo nos responda no significa que nos comprenda.

La diferencia es sutil en apariencia, pero enorme en sus consecuencias.

Tal vez el verdadero desafío de esta etapa tecnológica no sea construir máquinas cada vez más inteligentes, sino preservar la claridad sobre qué es una conciencia y qué no lo es. No se trata de frenar el desarrollo de la inteligencia artificial, sino de evitar que confundamos una conversación simulada con una relación real.

Porque detrás de una inteligencia artificial no hay una mente que nos escuche, sino un algoritmo que predice palabras.

Y quizá la cuestión más importante no sea hasta dónde puede llegar la inteligencia de las máquinas, sino hasta qué punto somos capaces los humanos de recordar quién está realmente al otro lado de la conversación.