Con la evolución y masificación de la Inteligencia Artificial, surge una pregunta que atraviesa la filosofía, la política y la cultura. ¿Qué ocurre con la ética cuando las decisiones empiezan a delegarse en sistemas cada vez más complejos? ¿La Inteligencia Artificial puede desarrollar un criterio ético? Mi respuesta es clara: no.

Con la inteligencia artificial esta cuestión está encima de la mesa con una intensidad particular. Gobiernos, universidades y grandes empresas tecnológicas hablan constantemente de ética de la inteligencia artificial, de marcos regulatorios, de supervisión ética de algoritmos y de la necesidad de construir sistemas capaces de tomar decisiones responsables.

Sin embargo, en medio de este debate percibo una confusión bastante habitual, se habla de ética cuando en realidad muchas veces se está hablando de moral, y aunque en el lenguaje cotidiano solemos utilizar ambos términos como si fueran equivalentes, en realidad existe una diferencia profunda entre moral y ética.

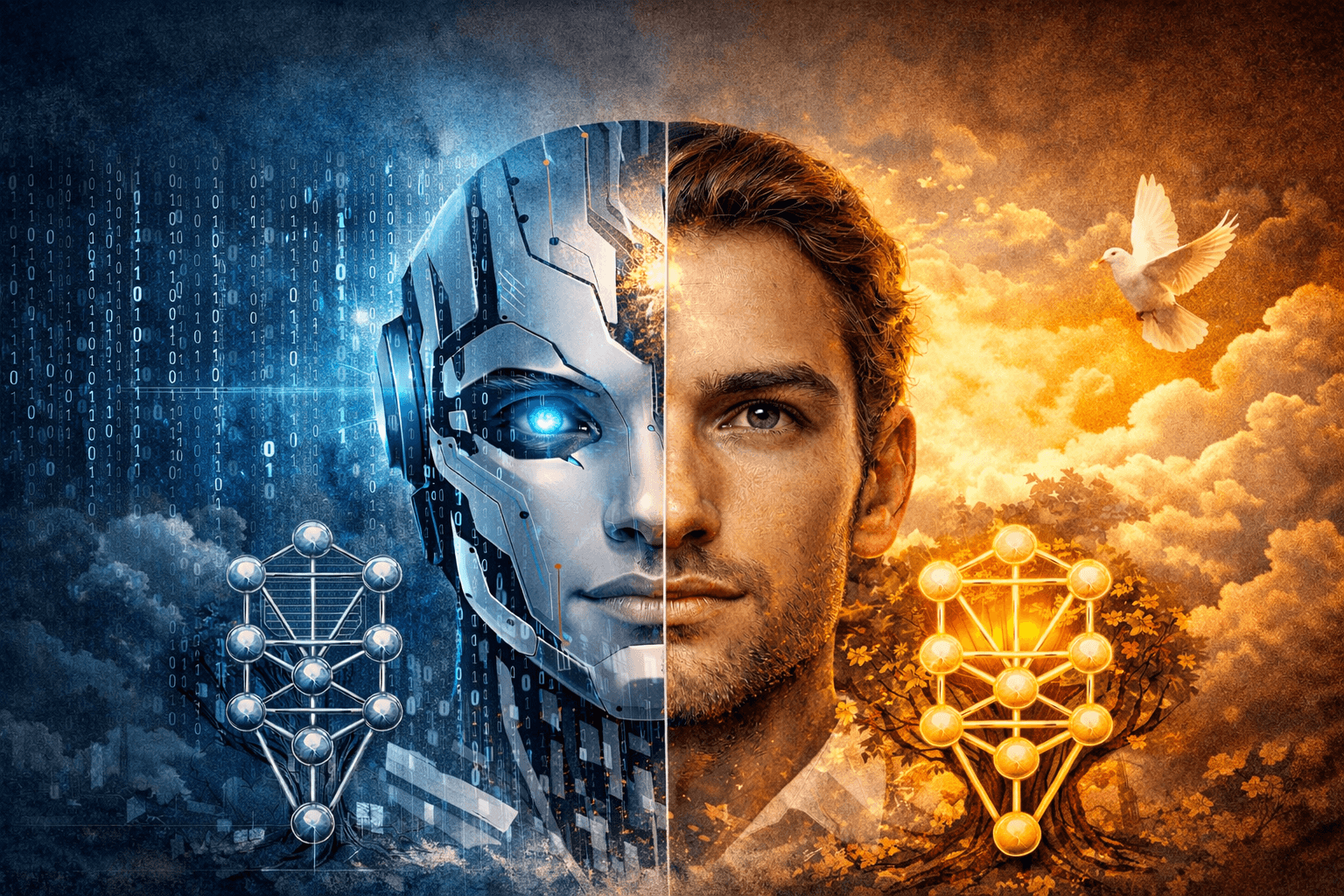

Comprender esa diferencia puede ayudarnos a entender también uno de los límites fundamentales de la inteligencia artificial y una de las virtudes de la consciencia humana.

La distinción comienza a hacerse visible cuando nos aproximamos al origen de las palabras. La palabra moral procede del latín mos, moris, que significa costumbre, aquello que una comunidad repite durante tanto tiempo que termina convirtiéndose en norma. La moral es, en este sentido, el conjunto de valores, reglas y condicionamientos que uno aprende porque una sociedad considera correctos dentro de un determinado momento histórico.

La moral depende del contexto cultural, de la tradición, de la religión dominante y también del equilibrio de poder que existe en cada época. Pero lo que en un momento histórico se considera incuestionable, puede resultar profundamente injusto un tiempo después o en otro lugar.

La ética en cambio, tiene una raíz distinta. Procede del término griego ethos, que se relaciona con el carácter y con la forma de habitar el mundo, no tanto con un sistema de normas externas como con una orientación interior que guía nuestras decisiones cuando las reglas existentes empiezan a quedarse pequeñas frente a una comprensión más amplia de la realidad.

A lo largo de la historia moral y ética han coincidido muchas veces, pero no siempre, y esa diferencia ha sido precisamente el motor de muchos cambios profundos para mejor en las sociedades humanas.

La moral cumple una función importante porque establece un suelo cultural compartido, un marco dentro del cual las personas pueden organizar su convivencia y desarrollar instituciones comunes. Sin algún tipo de moral compartida sería difícil sostener cualquier forma de sociedad.

Pero ese mismo suelo tiene también un límite. La moral siempre pertenece a una época concreta y lo que hoy se considera correcto puede resultar profundamente inadecuado cuando el tiempo introduce nuevas formas de comprensión.

Aquí es donde aparece la ética, los grandes saltos evolutivos de la humanidad suelen producirse cuando algunas personas sienten que la moral dominante ya no refleja una verdad más profunda. En esos momentos aparece una tensión entre lo que la sociedad considera correcto y lo que una conciencia más amplia empieza a intuir, una intuición que a menudo obliga a contradecir las normas establecidas para abrir un camino nuevo.

La historia está llena de ejemplos de este tipo de procesos, durante siglos, por ejemplo, la moral dominante aceptaba que las mujeres no participaran en la vida política. Aquella norma parecía natural dentro de la cultura de su tiempo y estaba respaldada por tradiciones, instituciones y estructuras de poder que nadie cuestionaba con demasiada facilidad.

Sin embargo, hubo personas que comenzaron a percibir que aquella exclusión no era justa. Algunas eran mujeres que reclamaban su lugar en la sociedad, otras eran hombres que entendieron que esa norma no reflejaba una comprensión más profunda de la dignidad humana. Desde la perspectiva de la moral del momento estaban desafiando el orden establecido, mientras que desde la perspectiva de la ética, estaban anticipando una evolución que más tarde acabaría integrándose en la propia moral. Por suerte, con el paso del tiempo, aquello que comenzó como una transgresión se convirtió en una nueva norma social.

Este patrón se repite constantemente en la historia humana. La moral funciona como un puente que permite organizar la vida colectiva durante un periodo determinado, pero ese mismo puente puede convertirse en una barrera cuando se interpreta como una verdad definitiva en lugar de entenderse como una etapa dentro de un proceso evolutivo más amplio.

Cuando la moral se absolutiza aparece el moralismo o el puritanismo, y esto suele generar una rigidez que termina frenando la evolución cultural y humana.

Las sociedades más vivas son aquellas que permiten que la ética dialogue con la moral y, cuando es necesario, la transforme.

Por otro lado, las máquinas pueden aprender patrones, analizar enormes cantidades de información y optimizar decisiones con una eficiencia extraordinaria. Este proceso de aprendizaje automático es precisamente lo que ha permitido el desarrollo reciente de sistemas de inteligencia artificial cada vez más avanzados.

Pero todo ese aprendizaje tiene una característica fundamental, siempre se basa en información pasada. Un sistema de inteligencia artificial aprende observando datos históricos, textos existentes, decisiones previas, jurisprudencia acumulada o comportamientos humanos registrados a lo largo del tiempo. En otras palabras, aprende de aquello que ya ha ocurrido.

Eso significa que una inteligencia artificial puede reproducir con bastante precisión la moral dominante de una sociedad. Puede identificar qué decisiones han sido consideradas correctas en el pasado y aplicar ese criterio de forma coherente en nuevas situaciones.

Lo que nunca podrá hacer es encaminarnos hacia decisiones que tengan un componente ético y que provoquen un salto humanísticamente evolutivo. No puede conectar con una fuente que trascienda esos condicionamientos históricos. No puede experimentar la tensión interior que lleva a una persona a cuestionar las reglas aceptadas de su tiempo, ni puede sentir esa intuición profunda que en determinados momentos empuja a algunos seres humanos a desafiar la moral vigente para abrir caminos nuevos.

Puede simular razonamientos éticos, puede analizar debates filosóficos o generar respuestas complejas sobre ética en la inteligencia artificial, pero siempre lo hará a partir de estructuras previamente programadas o aprendidas.

En ese sentido una inteligencia artificial puede ser moralista, pero nunca ética.

Puede aplicar con enorme precisión un sistema de normas que ya existe. Puede incluso ayudar a hacerlo de manera más coherente y menos arbitraria que los propios seres humanos. Sin embargo no puede generar por sí misma una ruptura creativa con ese sistema de normas.

Los grandes cambios éticos de la historia no han surgido de la optimización del pasado, sino de la capacidad humana para intuir algo que todavía no estaba codificado en ninguna tradición.

La ética, en ese sentido, parece estar vinculada a una dimensión de la conciencia que no se limita a reproducir patrones. Una dimensión que puede observar las reglas existentes y sentir que ha llegado el momento de atravesarlas para permitir que algo nuevo aparezca.

Por eso la inteligencia artificial probablemente no sustituirá nunca la responsabilidad ética del ser humano. Más bien ocurrirá lo contrario. Cuanto más deleguemos decisiones en sistemas inteligentes, más importante será recordar que esos sistemas operan dentro de los marcos morales que nosotros mismos les hemos proporcionado.

La evolución de esos marcos seguirá dependiendo de algo que ninguna máquina puede programar por sí sola, nuestra capacidad de escuchar una intuición que todavía no se ha convertido en norma.

Tal vez una de las contribuciones más interesantes de la inteligencia artificial no sea tecnológica sino filosófica, porque al enfrentarnos a sistemas capaces de replicar gran parte de nuestro razonamiento empezamos a comprender mejor qué parte de la mente humana puede automatizarse y cuál parece pertenecer a otra dimensión de la conciencia.

La moral puede codificarse. Puede aprenderse. Puede enseñarse a una máquina.

La ética seguirá siendo un territorio profundamente humano.

Y quizá esa sea una de las preguntas más importantes de nuestro tiempo, no tanto qué puede llegar a hacer la inteligencia artificial, sino comprender la dimensión trascendental y divina del ser humano.